◇人と同様の意識・意思必要か/「相棒」上手な活用が鍵に

大規模言語モデルであるChatGPTは、流暢に会話して翻訳・要約・プログラミングなど複数のタスクで、仕事を支援してくれる。あたかも優秀な相棒のようである。十分知的に見えるが、足らない知識を自ら獲得することはできない。今後、AIをさらに人の知能に近づけるには、もう一段のブレークスルーが必要といわれている。これは、人が持つ意識・意思にも関係する領域となるが、そのために何が必要か。また、AIのあるべき姿はどのようなものだろうか。

1957年当初、AI黎明期の研究の目的は、人と同等の知能を機械で実現することであった。しかし、現在のAIのほとんどは、一定の領域に特化した機能を実現したものである。また、その手法は深層学習だけでなく伝統的統計処理を含んだ幅広い機械学習・推論手法を用いている。人と同等の知能を、汎用AI(AGI:Artificial General Intelligence)と呼ぶ。AI黎明期では、AIに“概念の理解や自己修正の能力”を求めていた。しかし、大規模言語モデルのように、ひとつのAIモデルで複数のタスクを行うAIを汎用AIと呼ぶ人もいる。

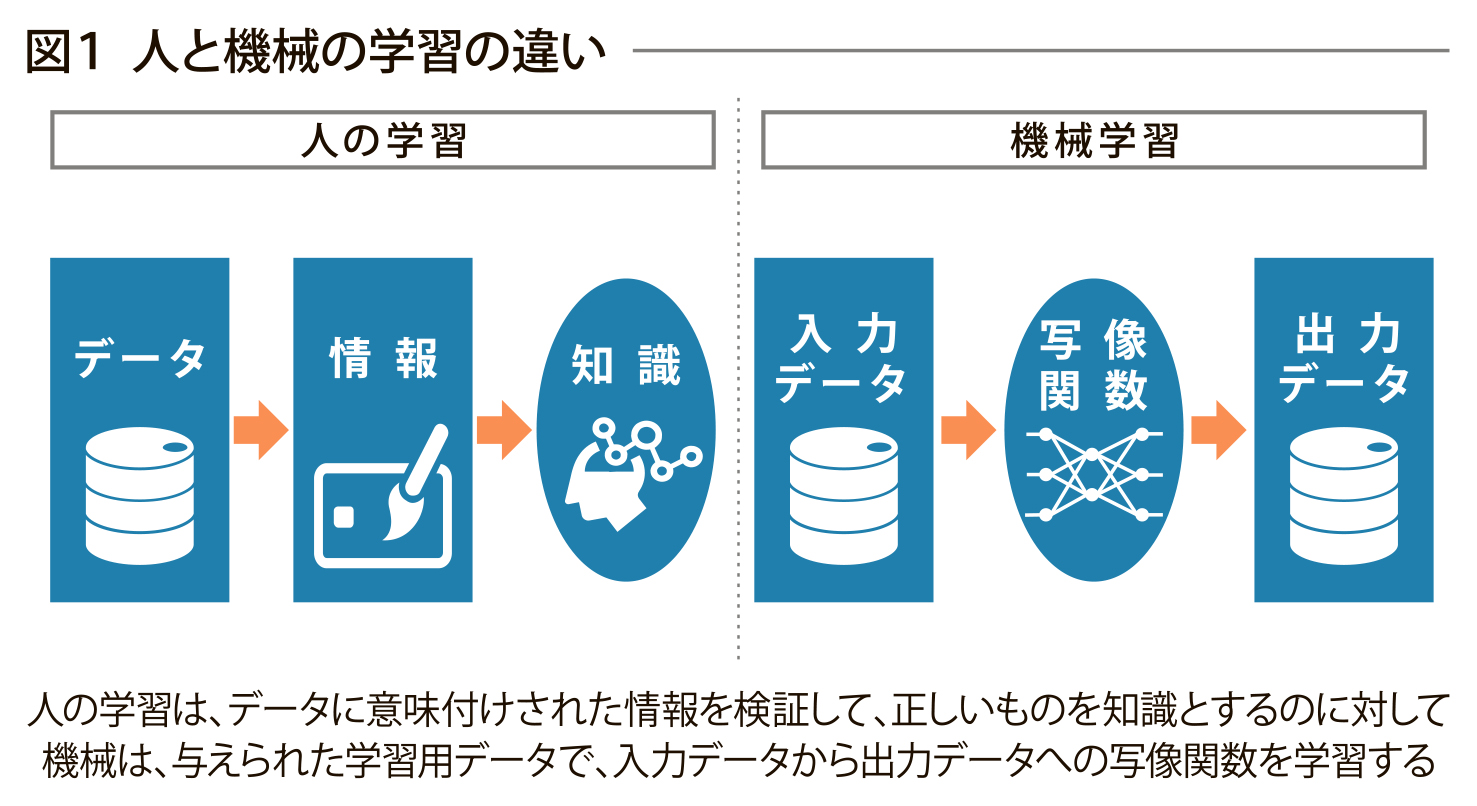

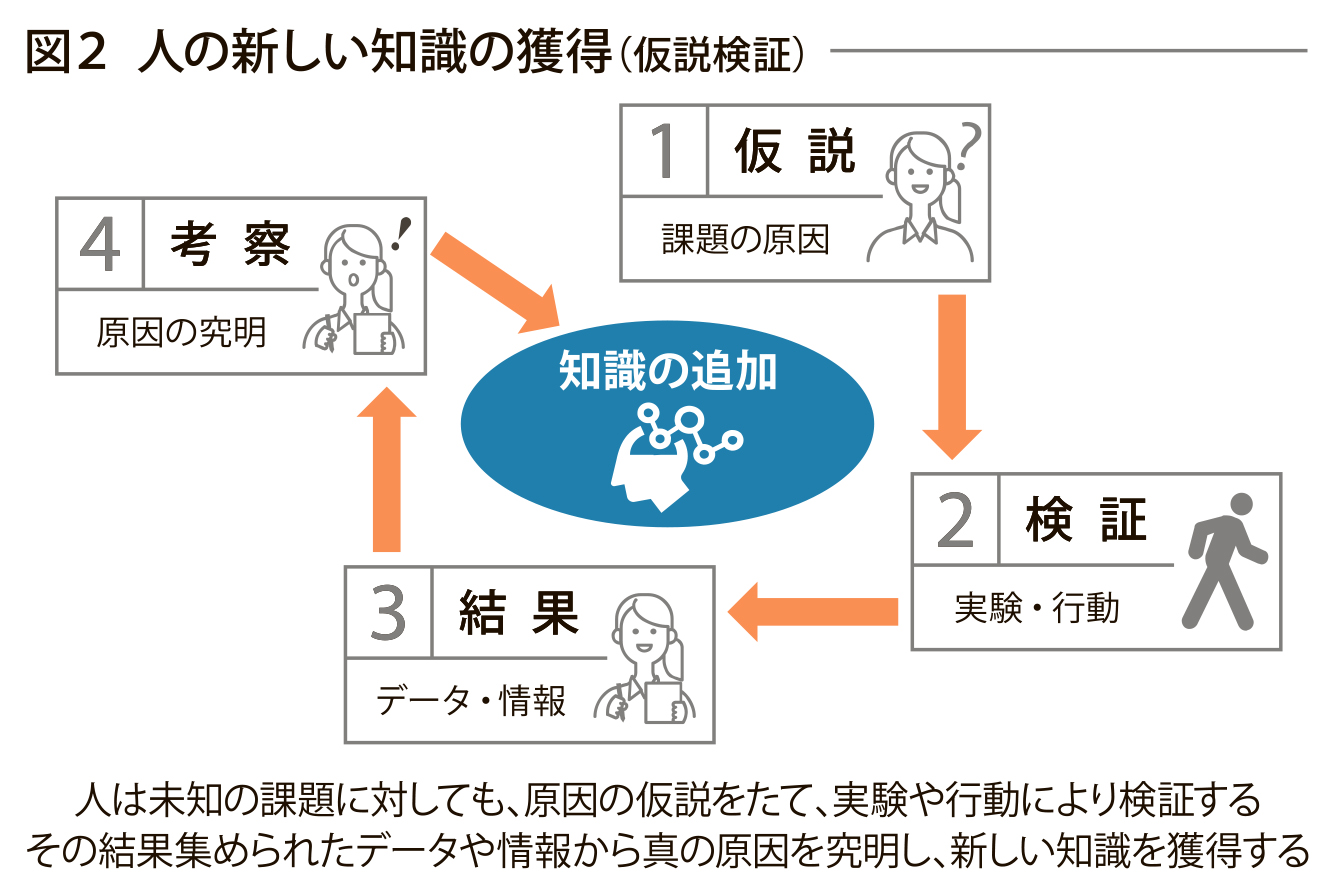

GPT―3を改良したChatGPTは、自然言語で人と会話ができる。しかし、入力文章に対応する文章を関数のように出力しているだけで、会話の内容を真に理解しているわけではない。よって、人の知能と同等とはいえない。人はデータに意味づけした情報の中から普遍的な事実を知識として蓄え利用する。また、人は未知な課題に遭遇しても仮説を立て、必要であれば検証し、真偽を確かめ新しい知識とする。人は新しい知識を自ら獲得できるが、今のAIは、自分自身を改善していく機能がない。何が正しいかを知らず、それを外から与える必要があるからだ。

◇賢く見えても関数

おそらく今の深層学習の枠組みだけでは、AIがどんなに賢く見えていても、入力に対して関数のように出力する機能しか実現できないだろう。このことを示す“中国語の部屋”という思考実験がある。部屋の中にいる中国語や漢字を知らない人が、中国語で書かれた質問カードに対して、返答マニュアルを見て、機械的に中国語で書かれたカードを選び返事をするとしよう。部屋の外の人は、中の人が中国語を理解していると錯覚することになる。

機械が人と同等の知能を獲得するには、身体を持ち五感を通して外界をセンシングし、言葉と実世界をリンクさせる必要があるというロボット研究者は多い。本当は、五感だけでなく温度感覚や平衡感覚など様々な感覚があり、人の感情にも関係している。人と同じ感覚を持つことで、AIが人の感情を推察し、よりきめ細かなサービスを提供できる可能性がある。介護ロボット分野では必要とされている機能である。さらにAIが人と同じように意識・意思を持つためには、“適切な目的”を与える必要があるとする有識者もいる。その目的に照らし合わせて獲得すべき知識を選別し、その良し悪しを判断できると期待されているからだ。

◇誤りは自分で確認

AIが人と同じような意識・意思を持たない方が、道具として利用しやすいと思う人もおり、この点は意見が分かれているようだ。GPT―4は大学院生レベルの能力を持つといわれている。よく物事を知っているが、その中に自然な形で誤りが入ることがある。現在はまだ、自分で確認できることをAIに任せる方が無難である。一方でAIを相棒とする仕事術が始まろうとしていることも事実だ。その相棒を上手に使いこなせる人が、職を失わずに生き残っていく。東芝でもAIのリスキリングを進める教育カリキュラムを準備し、次の時代に備えている。(この項終わり)

◆用語解説

◆汎用AI GPT―3が登場する以前は、人と同等の知能を持つAIという意味が強かった。GPT―3のようなAIを、多目的AI(GAI:General purpose AI)と呼び、汎用AIと区別することもある。

◆GPT―3・GPT―4 OpenAIによって開発された第3世代の大規模言語モデル。大量の文章データ(約45テラバイトから前処理された570ギガバイト分)を事前に学習し、少量の教師あり学習データで様々なタスクを実現したもの。後継のGPT―4はその規模が数倍と推察され、性能が格段に向上している。

◆リスキリング 新しい業務や職業に就くため、もしくは、現在の業務の効率をあげるために、新しいことを学んで、スキルを身につけること。